Quando si parla di sensori fotografici per fotocamere e videocamere sono molte le sigle e le dimensioni nominate. Le caratteristiche tecniche di questi sensori sono sempre diverse? Quali tipologie sono utilizzate dai principali brand sul mercato? A dimensioni maggiori corrispondono sempre prestazioni migliori? Queste le principali domande che in tanti ci facciamo. Oggi daremo molte risposte.

Il sensore fotografico è il “motore” di una fotocamera, che sia un’Utilitaria o una Formula 1 è quello che abbiamo sotto il cofano a determinare le sue potenzialità. Certamente poi è il Pilota che deve saper sfruttare al meglio le singole caratteristiche ma, per farlo, bisogna almeno conoscerle.

E’ importante quindi fare un piccolo viaggio che parte della nascita dei sensori fotografici digitali, passando per le diverse tipologie e caratteristiche specifiche, fino a quelli attualmente più diffusi sul mercato. Pronti? E allora via, partiamo!

Di cosa parliamo in questo articolo:

Cenni storici e funzionamento dei sensori fotografici

– Nascita e cenni storici

– Principi di funzionamento

Tipologie di sensori

- Principali caratteristiche

- Dimensioni

- Megapixel

Considerazioni finali

Cenni Storici e funzionamento dei sensori fotografici.

Per ogni tecnologia è interessante approfondirne le origini storiche, questo è utile per meglio inquadrare quali bisogni sono stati soddisfatti e quali sono state poi le evoluzioni.

Nascita e cenni storici

Nel 1975 Steve Sasson, un ricercatore della Kodak, sviluppa il primo prototipo di sensore fotografico lavorando su un sensore CCD (Charged Coupled Device). Questo sensore è capace di catturare la luce in due dimensioni trasformandola in segnale elettrico. Il passaggio successivo è trasformare gli impulsi elettrici in segnali digitali.

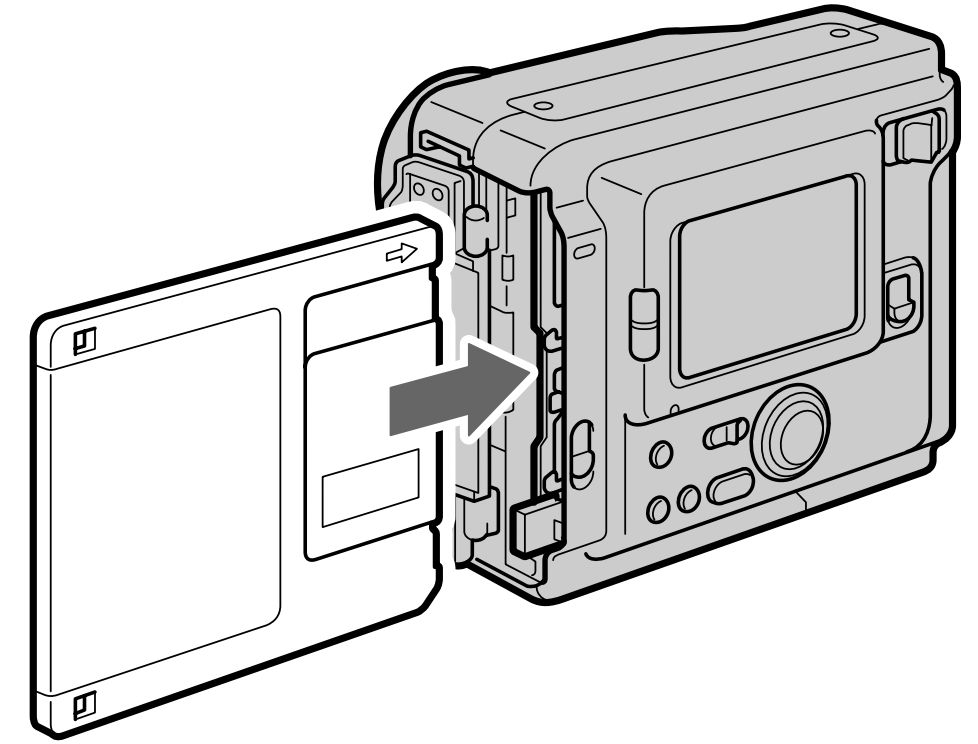

Successivamente nel 1978 depositava il brevetto, ma la tecnologia non è ancora matura per proporre sul mercato macchine fotografiche digitali che possano affiancare quelle tradizionali a pellicola. Bisogna aspettare il 1981 per vedere sul mercato la prima fotocamera digitale, la Sony Mavica FD5. Le immagini hanno una risoluzione 570×490 pixel e l’archiviazione del file è su Floppy Disk (da cui appunto la sigla FD).

Solo nel 1988 arriva sul mercato la Fuji DS-1P, capace di archiviare le immagini su una flash card rimovibile. Questo è possibile grazie alla riduzione dei costi di questo tipo di memorie a semiconduttore, ben più capienti dei Floppy Disk, il cui vantaggio era solo il basso costo.

E’ l’inizio delle fotografia digitale, come puoi immaginare c’è molto scetticismo su come questa tecnologia possa incidere negativamente sull’originalità degli scatti poiché le immagini digitali possono essere facilmente ritoccate. Ben presto invece appare evidente che l’espressività del fotografo può essere esaltata da questa tecnologia anche grazie ai SW di post-produzione. Proprio in quegli anni arriva la prima versione di Photoshop, con il nome di Display. Nel 1990 arriva ufficialmente Photoshop 1.0…ma questa è un’altra Storia!

Come è evidente ci sono delle similitudini nell’atteggiamento degli scettici dell’epoca con gli scettici attuali sui nuovi strumenti messi a disposizione dall’AI nel settore fotografico. La storia si ripete, ma la tecnologia si evolve indipendentemente da questi fattori. Si può scegliere di non utilizzare un nuovo strumento, ma l’unico risultato è rimanere indietro.

Principi di funzionamento

Ritengo utile semplificare il più possibile i vari elementi, per creare un quadro di base chiaro, sul quale poi poter approfondire elemento per elemento.

Confrontiamo il sensore digitale e la pellicola fotografica. Lo scopo di entrambi è lo stesso: catturare la luce e le informazioni dell’immagine posta di fronte all’obiettivo. Superato l’obiettivo luce che arriva alla Pellicola/Sensore.

La luce, attraversando l’obiettivo, colpisce la pellicola per ricreare l’immagine di una scena, che deve poi essere convertita chimicamente in una fotografia. Analogamente la stessa luce colpisce il sensore fotografico, che si occuperà di convertire queste informazioni in formato fotografico digitale.

Ecco come mi piace schematizzare questo processo:

Le modalità di conversione possono variare in base alla tipologia di sensore ma il processo generale è lo stesso. Il compito del sensore è quello di raccogliere la luce e i fotoni che lo colpiscono e convertire le informazioni in un file che conterrà tutti i dati sul colore, sulla tonalità, sulle luci e sulle ombre. I dati sono interpretati da processori di segnale, che creano l’immagine digitale che, a sua volta, verrà archiviata in schede di memoria (sono molto diffuse nei vari brand le SD Card, ma ce ne sono anche di altri tipi).

Il sensore fotografico è composto da un piccolo rettangolo di silicio più o meno grande. È costituito da milioni di fotodiodi (pixel) che convertono la luce in elettroni. Ogni pixel, infatti, è un elemento fotosensibile che, quando viene investito dalla luce, genera una carica elettrica e quindi una differenza di potenziale. Questa differenza di potenziale è proporzionale al numero di fotoni incidente (quindi all’intensità della luce incidente).

L’immagine generata in questo modo è in scala di grigi, quindi mancano ancora i colori. Come si fa quindi? Il primo sistema utilizzato è stato quello di aggiungere sulla superficie del sensore un filtro, detto “a Mosaico” (lo puoi vedere anche nell’immagine precedente, anteposto al sensore). Il più utilizzato è il filtro di Bayer, cioè una matrice, o mosaico, composta dai 3 filtri colorati RGB, chiamata CFA (Color Filter Array).

A questo punto del processo abbiamo ottenuto un vero e proprio mosaico. Tocca adesso al processore (altro elemento cardine delle fotocamere digitali) riempire, con un’interpolazione di dati, gli spazi tra un pixel e l’altro e ricostruire il colore originale della scena.

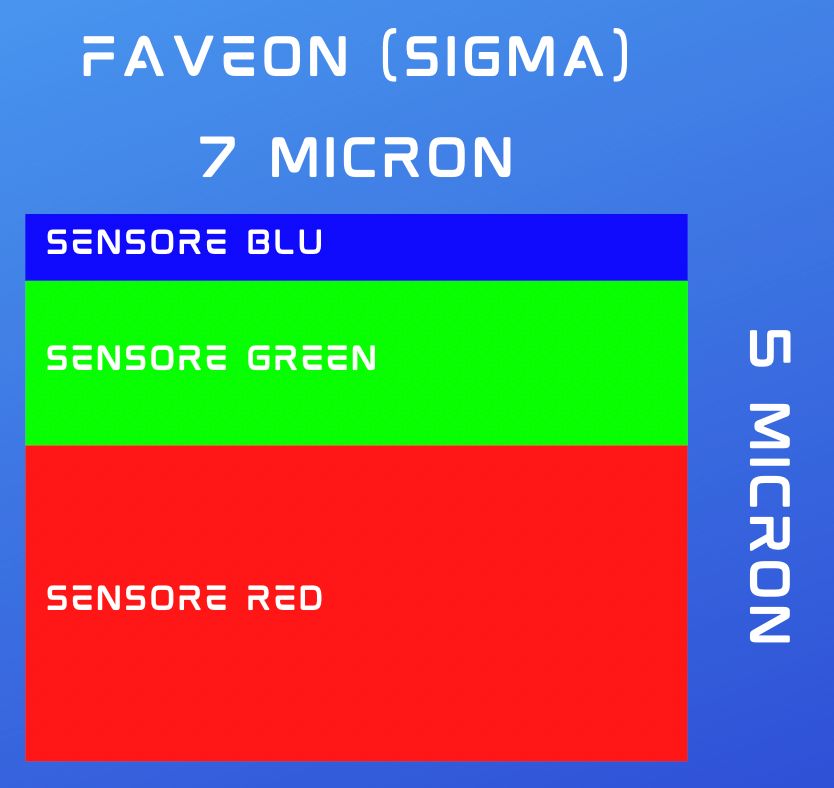

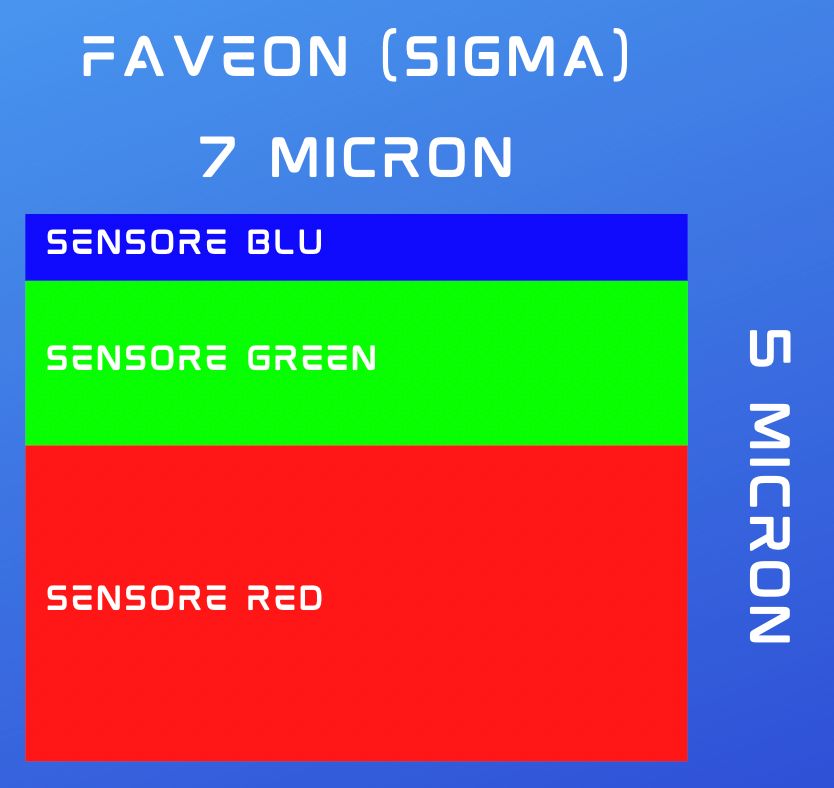

Un’alternativa al filtro a mosaico di Bayer è data dai sensori Foveon che “simulano” ancora di più la pellicola fotografica:

Questo sensore è prodotto da Sigmaed è costituito dalla sovrapposizione di tre strati diversi, ognuno capace di catturare un colore primario (RGB): così facendo viene meno la necessità di interpolazione tra pixel vicini. Nell’immagine sopra puoi vedere una sezione dei tre strati nel singolo pixel, le dimensioni e lo spessore sono in micron (milionesimo di metro/millesimo di millimetro) (i dati sull’immagine ci torneranno utili alla fine di questo articolo).

Tipologia di Sensori

I principi di funzionamento che abbiamo appena visto si concretizzano in alcuni prodotti ormai ampiamente diffusi sul mercato. Vediamo in cosa si differenziano e quanto sono importanti le loro dimensioni nei risultati fotografici.

Principali caratteristiche

I sensori principali sono due: CCD (Charge Coupled Device) e CMOS (Complementary Metal Oxide Semiconductor) in ordine di apparizione sul mercato. Il processo di conversione che viene seguito è lo stesso in entrambi, ma cambia dove viene eseguito.

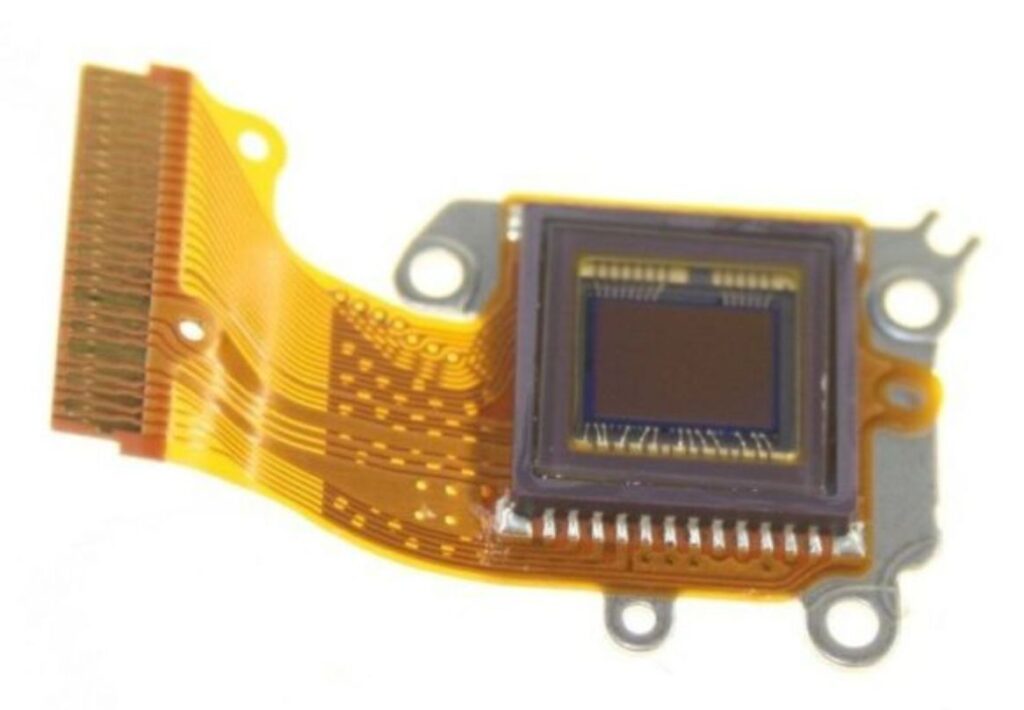

I CCD utilizzano un solo amplificatore di uscita. La carica elettrica, raccolta dai fotodiodi, viene trasferita fino ai bordi del sensore, dove viene poi amplificata e convertita. I CCD sono dotati di un’elevata gamma dinamica e maggiore sensibilità rispetto ai CMOS, hanno inoltre un livello di rumore inferiore, perché ci sono minori integrazioni all’interno della zona fotosensibile. Di seguito un esempio di CCD della Canon IXUS 850.

I CMOS invece convertono le cariche elettriche di ogni elemento in maniera indipendente su ogni fotodiodo. Il processo è più elaborato ma meno energivoro, perché in questo caso viaggia la differenza di potenziale e non la carica elettrica. Il minor consumo di energia comporta anche un minor surriscaldamento.

Da queste due categorie principali di sensori ne sono stati sviluppati altri come, per esempio, il Faveon X3 sviluppato da Sigma (di cui abbiamo parlato prima per il tema dei filtri).

Abbiamo poi i Live MOS che sfruttano la tecnologia CMOS riuscendo ad avere basso consumo e prestazioni paragonabili ai CCD. Sono utilizzati da Olympus e Panasonic sulle macchine con sensore “Micro Quattro Terzi”, non preoccuparti tra poco parleremo anche delle dimensioni dei sensori.

Ci sono poi i Super CCD di Fujifilm gli HR e SR con particolari forme dei fotodiodi che, nel caso degli SR, prevedono uno sdoppiamento.

Da notare poi i Super HAD CCD di Sony che, attraverso un fotodiodo particolare, hanno una sensibilità doppia rispetto al normale.

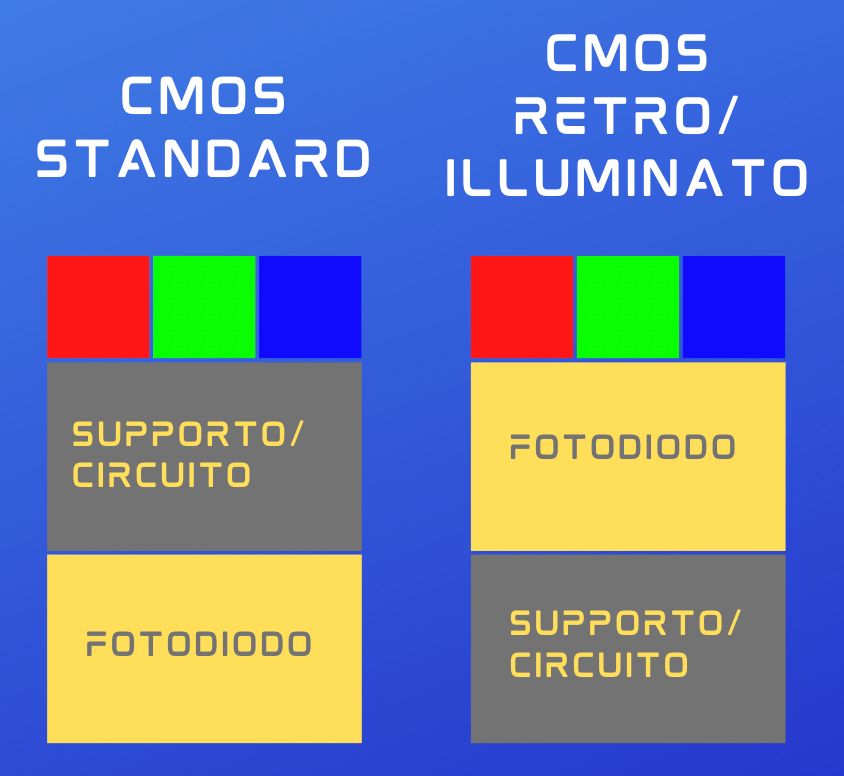

Arriviamo quindi ai CMOS retroilluminati come, per esempio, gli EXMOR-R di Sony. In questi sensori il fotodiodo è direttamente a contatto con la lente, a differenza degli altri tipi di CMOS. Questa inversione costruttiva elimina la dispersione del segnale luminoso.

Di seguito il sensore CMOS di Sony Alpha 1 da 50,1 MP.

Dimensioni dei sensori fotografici

Sentiamo spesso parlare delle dimensioni dei sensori fotografici in riferimento al più grande cioè quello denominato Full Frame 35mm. In questi ultimi anni però appaiono sul mercato sensori denominati Medio Formato con dimensioni maggiori del Full Frame 35mm. Quindi un “Full” è più piccolo di un “Medio”?

Prima di cadere nell’equivoco, meglio chiarire la situazione storica, partendo dalle delle dimensioni della pellicola. Un tempo la pellicola fotografica, in funzione degli utilizzi, aveva diverse dimensioni: Piccolo Formato (35mm), Medio Formato e Pieno Formato.

Con l’avvento dei sensori digitali, venne preso come riferimento per Pieno Formato Digitale il 35mm della Pellicola, chiamandolo Full Frame. Ecco quindi chiarito l’equivoco rispetto ai nuovi Medio Formato Digitale, che invece continuano a chiamarsi “Medio”. Facciamo subito la panoramica delle principali dimensioni di sensori lasciando fuori (in questo articolo) quelli più piccoli, che equipaggiano fotocamere compatte e smartphone, per semplificare le nostre osservazioni.

Nell’immagine ho condensato tutte le principali sigle che puoi trovare in commercio e le relative proporzioni rispetto al Full Frame 35mm evidenziato sempre in Rosso.

Possiamo notare che:

- Il nuovo Medio Formato (per esempio quello di Fujifilm) è decisamente più grande del 35mm. Vedremo in seguito questo su cosa può influire;

- APS-C di Sony, Fujifilm e altri è più grande dell’APS-C di Canon. Attenzione nella scelta degli obiettivi: il rapporto rispetto al Full Frame è 1,5 e 1,6 nel caso Canon;

- APS-H di Canon (per esempio la serie 1D) è più grande di tutti gli APS-C;

- FAVEON di Sigma è più piccolo di tutti gli APS-C;

- MICRO 4:3 è più piccolo ancora di FAVEON;

- Il sensore da 1” (inch/pollice), visibilmente più piccolo anche del MICRO 4:3, chiude questa panoramica generale delle dimensioni più diffuse sulle Foto/Videocamere.

Direttamente legato alle dimensioni fisiche del sensore è il Costo. I sensori fotografici sono tutti ricavati da un Wafer di silicio che ha un costo di mercato rilevante, come materia prima. Più le dimensioni del sensore sono grandi e meno sensori possono essere “intagliati” da un singolo wafer di silicio. Quindi quel sensore avrà un costo unitario maggiore. Più le dimensioni del sensore scendono, più scenderà il suo costo, perché dal wafer di silicio si potranno ricavare più sensori.

Megapixel

Il sensore fotografico è composto da un certo numero di fotodiodi disposti a scacchiera. Attraverso il processo che abbiamo descritto le foto risulteranno formate da un certo numero di punti, i Picture Element, comunemente noti come Pixel.

Facciamo quindi un esempio: se prendiamo l’immagine prodotta del sensore Exmor RS della Sony Apha1 cioè 8.640 x 5.760 pixel, facendo la moltiplicazione tra i due valori otteniamo 49.766.400 pixel cioè 49,8 milioni di pixel e quindi 49,8 Mega (M) Pixel (P).

Avrai notato però che le specifiche tecniche della Sony Alpha1 parlano 50,1 MP, perché questa differenza? Presto detto: il risultato della moltiplicazione che abbiamo fatto restituisce i Mega Pixel effettivi ai quali vanno sommati un certo numero di pixel che non si occupano della creazione dell’immagine ma di altre funzioni come per esempio il contrasto, l’abbattimento del rumore digitale e la temperatura dei colori. La somma dei due valori restituisce il numero di Pixel Totali che risultano maggiori rispetto a quelli dei pixel effettivi che abbiamo calcolato nell’esempio.

Ecco quindi che possiamo fare alcune importanti considerazioni sulle dimensioni dei sensori e dei fotodiodi basandoci su tutte le informazioni raccolte fino ad ora.

Aumentare la dimensione del sensore:

- un sensore più grande produce un’immagine di miglior qualità, a parità di MP, perché possiamo utilizzare fotodiodi giù grandi, che a loro volta possono raccogliere un quantitativo maggiore di luce;

- raccogliere più luce e informazioni si traduce, sulle nostre foto, in minor presenza rumore ed una gamma dinamica più ampia con maggiori dettagli anche in zone di alte o basse luci;

- non vengono prodotti per ora sensori ancora più grandi, principalmente per un problema di costo, ma anche per le conseguenti dimensioni maggiori delle foto/videocamere e dei relativi obiettivi.

- I sensori più grandi porterebbero a un consumo energetico maggiore e ad una catena HW, per il trasferimento e la conversione dei dati, ancora più complessa e costosa.

Ridurre la dimensione dei fotodiodi:

- avere più fotodiodi con dimensioni minori, porterebbe ad una maggiore definizione dell’immagine ma ad una minore capacità di catturare la luce;

- la ridotta capacità di catturare la luce, di fatto, rende necessario amplificare il segnale fornito dai fotodiodi per avere un’immagine più chiara. Per amplificarlo lo moltiplichiamo per un fattore, ecco che scendono in campo gli ISO;

- aumentare però il numero di ISO porta ad un aumento del rumore.

Da quanto sopra emerge la necessità di trovare una via di mezzo che riesca ad individuare le dimensioni dei sensori fotografici sufficienti ad avere un buon numero di fotodiodi (definizione) senza rischiare di aumentare troppo il rumore. La soluzione viene data dalle caratteristiche fisiche della luce. La lunghezza d’onda (𝝀) della luce visibile rientra nel range di 0,4-0,7 micron. Un fotodiodo di dimensioni inferiori a questo range non potrebbe catturare il fascio luminoso. Ecco quindi perché, per esempio, nei sensori APS-C i fotodiodi misurano 5-6 micron e per le Full Frame 8-10 micron.

Questo risultato ti ricorda qualcosa? Ecco spiegato perché il sensore Faveon, che avevamo analizzato solo dal punto di vista costruttivo, ha quelle dimensioni del fotodiodo.

Considerazioni finali sui sensori fotografici

La tecnologia, anche nel settore dei sensori fotografici, ha fatto passi da gigante e continua anche mentre scrivo questo articolo.

Ora però ti sarà più chiaro perché dire, per esempio, che due fotocamere sono in grado di registrare in formato 4K senza specificare con quale sensore, con quanti Mega Pixel, con quale processore e con quali caratteristiche del file di output, è come dire che due auto sono in grado di circolare in autostrada…senza specificare altro sulle caratteristiche specifiche che le differenzierebbero dal punto di vista tecnico, delle prestazioni e del costo.

Sarà molto interessante seguire, nei mesi a venire, quali saranno le proposte dei vari brand e tornare poi, partendo da questo articolo, a fare il punto sul mercato dei sensori e le nuove possibilità che daranno a tutti gli appassionati e professionisti.

I credits di ogni immagine sono riportate nelle varie didascalie.